Praxis

iZotope RX 10 – Installation

iZotope RX 10 wird über die iZotope Product Portal App heruntergeladen und installiert. Wer noch keinen iZotope-Account hat und RX10 trotzdem unverbindlich testen möchte, lädt sich den 1,79 GB großen Installer nach Eingabe einer Mailadresse direkt auf der iZotope-Website herunter.

Repair Assistant in der Praxis

Seit der Einführung des Mix Assistants in Neutron hat iZotope die künstliche Intelligenz stetig weiterentwickelt. Auch in Ozone 10 ist der Mastering Assistant eine echte Hilfe, um den Sound „auf Knopfdruck“ zu verbessern. Die Ergebnisse beider KIs liefern jedenfalls brauchbare Startpunkte für eigene Settings. Doch wie gut ist der Repair Assitant in RX? Die Handhabung ist, wie von iZotopes Assistants gewohnt, kinderleicht. Den Repair Assistant gibt’s auch in der Standardversion verfügbar – außerdem kann man ihn sowohl als DAW-Plugin als auch in der RX Editor App einsetzen.

Ich füge den Repair Assistant als Plugin in der DAW ein, drücke „Learn“ und schon beginnt die Analyse des Audiomaterials. Der Assistant kommt mit den Modulen De-Ess, De-Reverb, De-Click, De-Clip und De-Noise und unterscheidet zwischen Vocals, Instrumenten und Effektsounds. Überrascht hat mich, dass kein De-Hum-Modul mit dabei ist, aber immerhin bekam ich einige Standardproblemchen wie etwa ein stark rauschendes Mikro oder den Raumnachhall in den Griff.

Gut, aber hungrig

Auffällig ist der CPU-Ressourcenbedarf: Auf meinem MacBook Pro 2019 i7 mit 64 GB RAM genügt eine Assistant-Instanz und schon schießt einer der 16 Threads in Logic auf etwa 70% – bei drei Assistant-Instanzen ist die CPU lahmgelegt und nichts geht mehr. Wer viele Spuren bearbeiten will, sollte lieber mit den richtigen RX Modulen arbeiten und nicht auf den Assistant setzen. Um mal eine Spur von einem Interviews in den Griff zu bekommen, geht das schon mal klar. Die Ergebnisse sind brauchbar, wenngleich die KI die Schwachstellen nicht immer selber erkennt.

Für dich ausgesucht

Eine Aufnahme hatte sehr viel Nachhall, den die KI nicht entlarvt hat. Den De-Reverb hat sie nach der Analyse auch nicht aktiviert. Das deutlich hörbare Rauschen aus einer weiteren Aufnahme hat sie ebenfalls nicht stark genug vermindert. Man kann sich also nicht wirklich auf den Assistant verlassen. Die Bedienung ist dafür einfach: Mit nur einem Regler pro Modul kommt man schnell zu brauchbaren, artefaktarmen Ergebnissen.

In den Klangbeispielen hört ihr eine Aufnahme, die ich mit dem Rode SmartLav+ Lavaliermikrofon und einem iPhone 12 Pro vorgenommen habe. In der Aufnahme ist das Grundrauschen deutlich hörbar. Der Assistant erkennt es und aktiviert unter anderem das De-Noise-Modul. Nachregeln muss man allerdings selbst, wenn man das Rauschen tatsächlich hörbar beseitigen möchte.

In einem weiteren Take habe ich bewusst in einem Hausflur mit langem Nachhall aufgenommen. Im Hintergrund hört man noch das hochfrequente Surren eines Netzteils. Der Assistant hat den Hall zwar selbst erkannt, ihn leider jedoch kaum beseitigt. Nach manueller Aktivierung des De-Reverb-Moduls und dem Feinjustieren weiterer Module kommt man schon zu einem besseren Ergebnis. Komplett bekommt man den Nachhall mit dem Assistant jedoch nicht entfernt.

Multiple Speaker und Textnavigation in der Praxis

Beide Funktionen sind leider aktuell nur in englischer Sprache nutzbar, und das auch nur in der Stand-alone-App RX10 Editor. Die multiple Speaker Detection funktioniert zuverlässig. Pro Sprecher erkennt sie den Text und markiert ihn in einer eigenen Farbe. Die Spracherkennung ist in etwa vergleichbar mit der automatischen Generierung von Untertiteln bei YouTube- oder Facebook-Videos. Teilweise erkennt sie andere Wörter, die phonetisch ähnlich klingen.

Bei gesprochenen Wörtern funktioniert das Ganze besser als bei Gesang, wie ihr in folgendem Video sehen könnt. Wer allerdings mit großen Textfiles arbeitet oder sich an den Wörtern orientieren muss, um sich im Audiofile zurechtzufinden, dem genügen vielleicht auch schon einzelne Wörter. Dafür reicht die Text- und Sprechererkennung aus – sofern man mit englischen Files arbeitet.

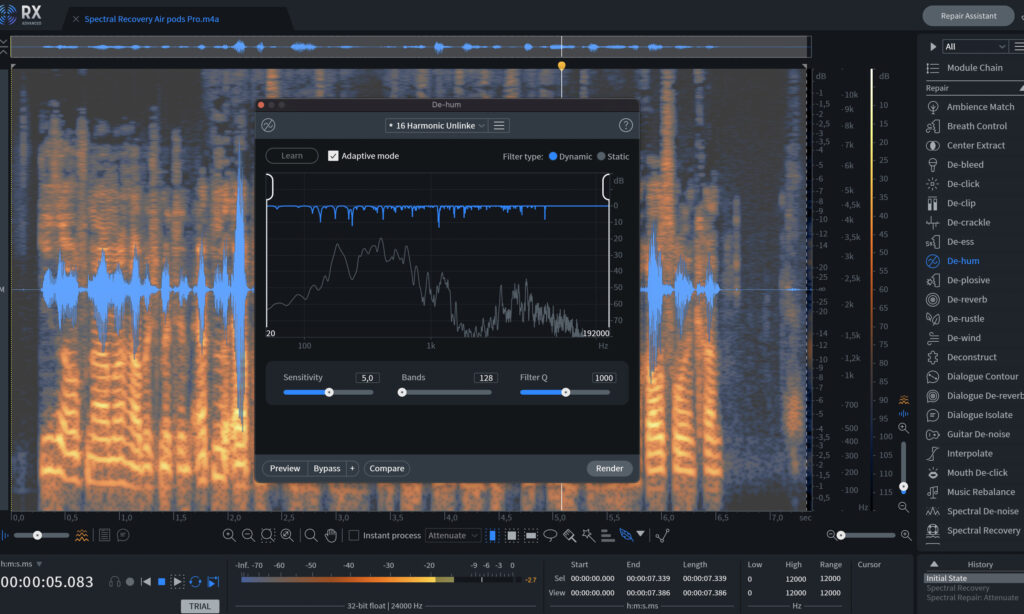

Stresstest: Adaptive Dynamic Mode in De-Hum-Modul

Das De-Hum Modul wurde aufgebohrt und mit einem adaptiven dynamischen Modus erweitert. Dieser ermöglicht es, Audio in Echtzeit zu bearbeiten, anstatt es zuvor analysieren zu müssen.

Auf diese Weise kann man Störgeräusche besser aufspüren und eliminieren. In den folgenden Aufnahmen habe ich im Hintergrund den Lüfter eines Notebooks mit aufgenommen. Für den extra Stresstest habe ich sogar einen Staubsauger mit nur einem Meter Abstand laufen lassen. Wie schlägt sich das De-Hum-Modul in solchen Extremsituationen?

Der adaptive, dynamische Modus lässt das Ergebnis sogar recht natürlich wirken, den Umständen entsprechend, versteht sich. Aber: Den Notebook-Lüfter erkennt er im Grunde nur als Noise, wodurch De-Hum alleine kaum einen Unterschied macht. Beim Staubsauger hört man, dass das De-Hum-Modul nur noch Rauschen übrig lässt.

Zum Glück kommt RX 10 mit genügend weiteren Helferlein. Und die besten Ergebnisse erhält man ohnehin mit mehreren Modulen in Kombination. In diesem Fall habe ich zusätzlich das Dialog Isolate Modul und den Repair Assistant verwendet. Es ist schon erstaunlich, was sich mit wenigen Klicks aus dem Audio mit einem deutlich hörbaren Staubsauger noch rausholen lässt. Zwar treten durch die verschiedenen Module auch leichte Artefakte zum Vorschein, dafür ist der Staubsauger aber nicht mehr zu hören!

Wie klingt das verbesserte Spectral Recovery Feature?

In der Stand-alone-App der Advanced Version hat iZotope die Spectral Recovery Technologie überarbeitet. Diese ermöglicht es, mittels machine-learning fehlende Frequenzanteile hinzuzufügen – beispielsweise von Aufnahmen, die nicht mit professionellem Equipment aufgezeichnet wurden, etwas mit einem Smartphone oder einem mobilen Headset. Im Folgenden hört ihr wieder eine Aufnahme, die ich mit dem internen Mikrofon des iPhone 12 Pro vorgenommen und mit Spectral Recovery bearbeitet habe.

Beim iPhone-Mikrofon hat Spectral Recovery keine sonderlich große Verbesserung erzielt. Man muss aber fairerweise sagen, dass das Handy mittlerweile schon sehr brauchbare Aufnahmen macht. Legen wir noch eine Schippe drauf: Das schlechteste Mikrofon, das ich kenne, in dem das Wort „Pro“ vorkommt, ist das in den Apple AirPods Pro.

Takes, die man mit diesem Mikrofon durchführt, klingen sehr verlustbehaftet und sind für ernsthafte Aufnahmen nicht zu gebrauchen. Was kann Spectral Recovery daraus zaubern? Nach einem Klick auf „Learn“ analysiert es das Audiofile und schlägt entsprechende Settings vor. Leider ist das Audio anschließend noch unbrauchbarer. Überzeugen kann mich Spectral Recovery also nicht.