Praxis

Der Sensor und die iOS-App

Beginnen möchte ich mit der „mobilen“ Variante, also der Version „Sensor und iPad“ (ebenso möglich wie iPhone). Voraussetzung ist das Betriebssystem iOS 8 und höher auf dem jeweiligen Gerät. Um überhaupt erst einmal zu beginnen, steht nach dem Download aus dem App Store die zuvor erwähnte Online-Registrierung an, die aber innerhalb von Sekunden vollzogen ist. Sofort danach öffnet sich die Anwendung. Das Sensorkabel wird dann flugs in den Audio/Kopfhörer-Ausgang des iPad gesteckt, die verbliebene Miniklinken-Buchse des Steckers dient zur Aufnahme eines Kopfhörers oder als Verbindung zu einem Audio-Ausgabegerät wie einem Mischpult oder ähnlichem. Den Sensor selbst platziere ich zunächst auf meiner Tischplatte und beginne einfach mal mit dem „Trommeln“. Finger, Knöchel, Faust, ein Stift und ein Messer kommen zum Einsatz, nachdem ich das nicht zu übersehende „Plus“-Icon auf dem Touchscreen gedrückt habe. Dann wird mir wieder klar, dass ja eine der Besonderheiten des Mogee Systems ist, dass man durch verschiedene Gesten („Gestures“) auch verschiedene Signale/Sounds auslösen kann. Also konzentriere ich mich auf eine Zone rund um den Sensor und eine Anschlagsart (Knöchel), während ich den „Hit Detector Threshold“ so justiere, dass er schön Pegel hat, ohne zu sehr in den roten Bereich zu kommen.

Deutliche Probleme bei der Kallibrierung

Leider ist das Ergebnis auf dieser Spielfläche, sobald eine zweite und dritte Geste hinzu kommen (das System erlaubt maximal fünf Gesten pro Sensor), ernüchternd. Von einer Trennung der Gesten in der Ausgabe – das sieht man auch am Aufleuchten der entsprechenden drei Kreise – kann nicht wirklich die Rede sein, auch nicht nach erneutem Anlernen und Änderungen des Schwellenwertes (Threshold) oder der globalen Sensitivity. Hm, das macht bisher noch keinen richtigen Spaß… Na gut, dann eben so, wie ich es in einem Demo-Video zu Mogees gesehen habe: Die Schlafzimmertür muss nun herhalten. Sensor weg von der Platte, ran an die relativ dünne Holztür. Aber was mache ich nur falsch…? Auch hier stellt sich das erhoffte Aha-Erlebnis nicht ein, erneut sind die drei Gesten trotz deutlich unterschiedlicher Anschlagsarten und gewissenhaftem Anlernen nicht sauber voneinander getrennt, überlappen sich teilweise (auch optisch in der App) und lösen fast ausschließlich gemeinsam aus. Und dann knallt auch noch der Sensor runter, obwohl ich ihn einige Sekunden lang fest angedrückt hatte. Ratlosigkeit macht sich breit. Ich lese mir noch einmal alles zum Produkt durch, was ich online finden kann und vergewissere mich, nichts Entscheidendes übersehen oder vergessen zu haben. Aber ich finde den Fehler nicht und verliere ein wenig den Glauben an die grundsätzlichen Fähigkeiten des Mogee Sensors. Also gut, nächster Versuch: Objekte mit einer gewissen Eigenresonanz scheinen geeigneter als massive, daher kommt nun eine metallene Salatschüssel zum Einsatz. Trotz erneutem und konzentriertem Anlernen bleibt das Problem der „Nicht-Trennung“ bestehen. Als ich einen Stift als „Stick“ nehme, wird es etwas besser, es gibt zwar noch immer keine klare Trennung, aber zumindest kann man mit viel Wohlwollen einen zweistimmigen Beat zwischen den Knöcheln der einen Hand und dem Stift in der anderen erzielen.

Aber ehrlich gesagt: geil ist anders. Kommt eine dritte und mehr Gesten dazu, wird es noch schwieriger. Es folgen ein metallenes Nudel-Abtropf-Sieb, mehrere Teekannen, eine große und eine mittlere Tasse, ein Alu-Case und ein 12“ Trommelkessel. Mal steht das Objekt auf dem Tisch, mal auf einem absorbierenden Tuch auf dem Boden, dann halte ich es auf den Knien – nichts führt zu brauchbaren, spaßbereitenden Ergebnissen.

Ich gönne mir und dem Sensor nach dieser doch ernüchternden Kennenlernphase ein freies Wochenende und bespreche mich mit den Kollegen in der bonedo Redaktion. Schließlich möchte ich ein neues Produkt nicht einfach „aburteilen“, zumindest nicht, ohne alle Eventualitäten wie die eines „Montag-Geräts“ ausgeschlossen zu haben. Wir entscheiden, den Vertrieb um die Zusendung eines weiteren Sensors zu bitten.

Auch die zweite Testphase steht unter dem Motto „No Satisfaction“

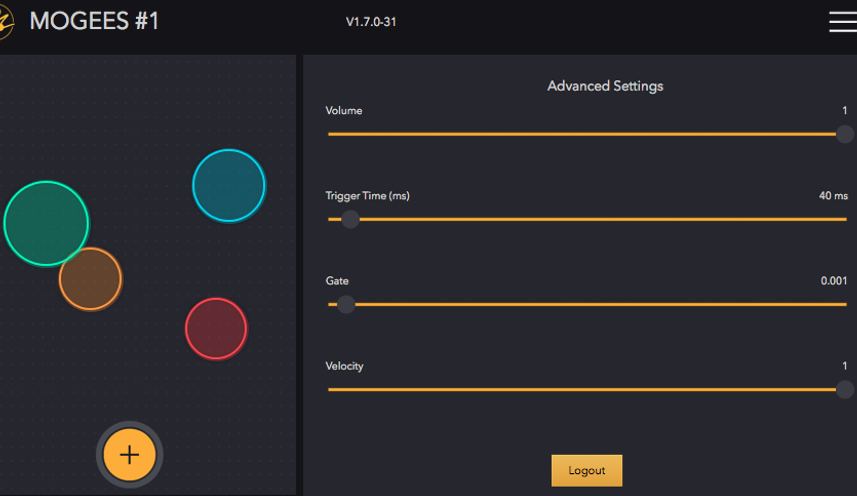

Nun sind ein paar Tage vergangen, und ein weiteres kleines Paket kommt zu mir nach Berlin. Ich habe mir erneut alle möglichen Gegenstände zurecht gelegt (Tischplatte, Alukoffer, Pappkarton, Holztür, Nudelsieb aus Metall, Salatschüssel aus Metall, Keksdose aus Blech, Glaskanne, Tassen…) und beginne einen zweiten Testlauf. Achtung: Trommelwirbel…. Verdammt, es ist dasselbe Problem wie schon beim Versuch mit dem ersten Sensor, also offenbar kein „Montags-Teil“. Egal, welches der genannten Objekte ich nutzen will, das Ergebnis, und zwar zum Teil bereits bei der ersten anzulernenden Geste (z.B. Kugelschreiber an Glaskanne) ist, sorry, schlicht desolat. Ich justiere immer wieder den Threshold-Wert in der App, experimentiere in den „Advanced Settings“ mit der Eingangs-Empfindlichkeit und gebe mir wirklich Mühe, etwas Brauchbares aus dem „Instrument“ heraus zu bekommen.

Keine Mobilität, aber etwas bessere Ergebnisse: Die VST/AU Plug-In Variante

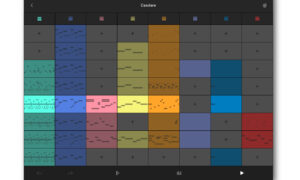

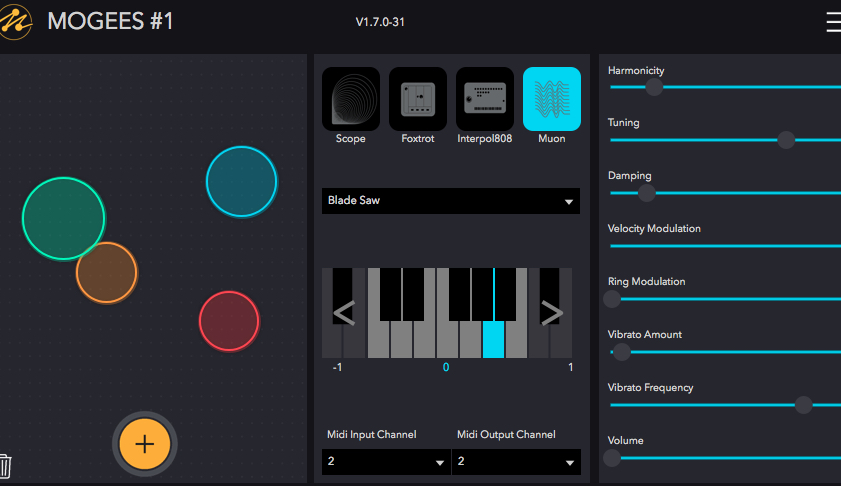

Auch wenn das Mogees Sensor Pack in Sachen iPad bei mir inzwischen endgültig durchgefallen ist, möchte ich das Konzept der Plug-In Version hier noch erläutern: Schließt man den Sensor nicht an ein iPad/iPhone an, sondern verbindet selbigen mit dem mitgelieferten Adapter und diesen dann wiederum per Klinkenkabel mit dem Eingang einer Soundkarte, kann der Sound aus dem Plug-In, welches man in eine Audiospur mit aktivem Monitoring / Aufnahmebereitschaft legt, aufgenommen und entsprechend weiterverarbeitet werden. Außerdem verfügt die Plug-In-Variante über die Fähigkeit, MIDI in beide Richtungen zu verarbeiten: Mit Hilfe virtueller MIDI Ports aus der App ist es also möglich, den Sensor über MIDI Out als MIDI-Controller einzusetzen und Instrumente wie Synths oder E-Drums oder was auch immer im Rechner an Soundquellen schlummert, anzusteuern und zu spielen. Stellt man in der App für jede angelernte Geste einen eigenen MIDI-Kanal ein und legt in der DAW (in diesem Fall Ableton Live) für jede Geste einen eigenen Track samt individuellen MIDI-Kanal an, kann mit jeder Geste ein anderes Instrument angesteuert werden. Für jeden verbundenen Sensor steht ein MIDI-Controller namens „Mogees # 1, 2, etc. “ zur Verfügung, der als MIDI-Eingangs-Controller in der jeweiligen Spur ausgewählt werden kann. In der entgegengesetzten Richtung, also über MIDI In, lassen sich wiederum MIDI-Noten aus der DAW an das Plug-In senden, wodurch es möglich ist, dieselbe Geste beim live-Anspielen von den programmierten MIDI-Noten aus der DAW beispielsweise in der Tonhöhe zu verändern und so ein quasi synchronisiertes Zusammenspiel zu erreichen. Das sind durchaus interessante Features, schade nur, dass die Hauptsache, das „Sensoring“ der Anschläge so unbefriedigend ist. Die Kalibrierung innerhalb der Plug-In Variante funktioniert ein klein wenig besser als mit dem iPad, von „Plug-And-Play“, wie Anleitung und Videos versprechen, und „Super-Spiel-Spaß“ kann aber dennoch leider keine Rede sein.

Für dich ausgesucht

Die Sounds …

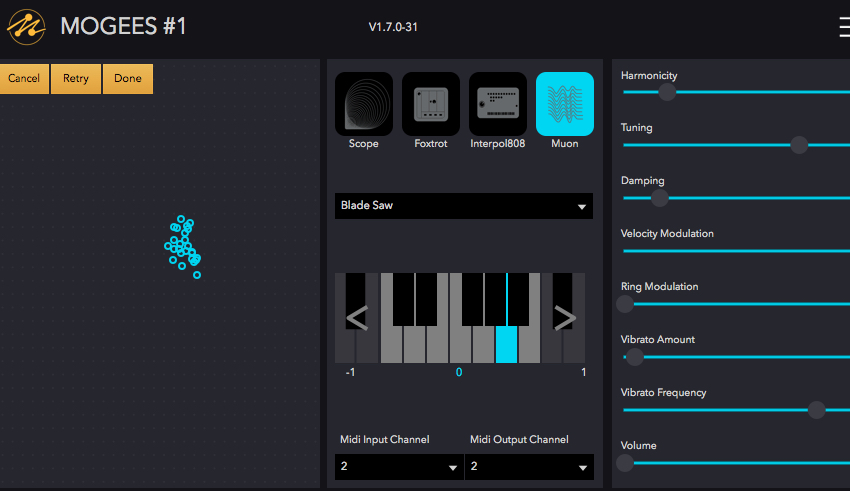

treten bei den aufgetretenen grundsätzlichen Problemen natürlich in den Hintergrund. Wenn man nicht ansatzweise vernünftig trommeln kann, ist die Qualität und Vielfalt der mitgelieferten Klänge nur zweitrangig. Dennoch will ich kurz beschreiben, welche vier „Sound Engines“ in den Apps verbaut sind:

Muon“ ist ein modularer Synthesizer, „Interpol 808“ emuliert eine klassische Drum Machine, „Scope“ ist ein “Natural Vibration Re-Synth“, und mit „Foxtrott“ vervollständigt ein perkussiver Drum Synthesizer mit Retro-Electro-Charakter das Quartett.

In jedem Klanggeber sind 20 Presets zu finden, die sich durch weitere Parameter-Einstellungen (Filter, Delays, Damping, Vibrato…) individuell verändern lassen. Die Qualität, Verwertbarkeit und „Einzigartigkeit“ dieser Sounds ist nicht besser oder schlechter, als man es von anderen Klanggebern dieser Preis- und Güteklasse kennt und stellt somit keine Überraschung dar. Klingt alles ganz ok, ohne dass einem dabei die Kinnlade vor Begeisterung herunter fällt. Die Möglichkeit, eigene Sounds anzuspielen, scheint mir da im zweiten Schritt über das Plug-In doch die spannendere Variante zu sein.

Sound-Beispiele für diesen Test aufzunehmen, die die beschriebenen Schwierigkeiten mit der Kalibrierung des Sensors dokumentieren, war gar nicht mal so einfach. Wir haben uns schließlich dazu entschieden, mit einem Kondensator-Mikrofon direkt im Raum aufzunehmen, so dass sowohl die generierten Klänge aus der App als auch der „echte“ Anschlag am Objekt zu hören sind. Das klingt nicht so schön, wie Ihr es sonst von uns gewohnt seid, verdeutlicht dafür aber das Problem. Bei allen Beispielen ist deutlich herauszuhören, dass die unterschiedlichen Gesten (Kugelschreiber, Daumen-Slap, Faust auf Tisch, Fingerkuppen, Fingerknöchel etc., jeweils drei davon pro Beispiel), nicht sonderlich gut funktionieren, was sich im nicht konstanten oder fehlendem Auslösen oder dem Auslösen mehrerer Sounds gleichzeitig zeigt.